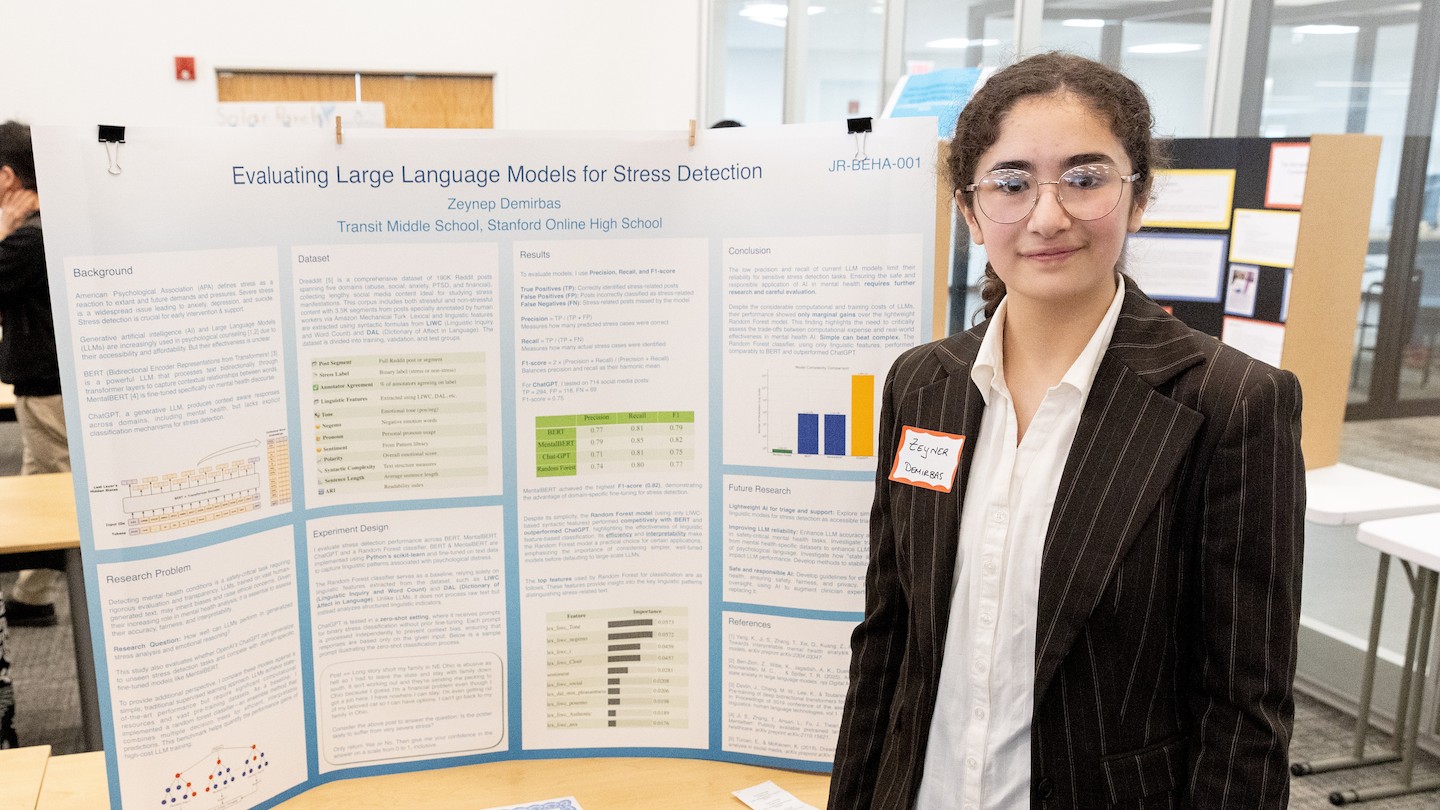

Die Erfahrung eines Mittelschülers mit einem Chatbot mit künstlicher Intelligenz (KI) hat Bedenken hinsichtlich der Abhängigkeit von KI zur Unterstützung der psychischen Gesundheit deutlich gemacht. Der Student, der an der Thermo Fisher Scientific Junior Innovators Challenge teilnahm – einem von der Society for Science veranstalteten Wettbewerb für Mittelschüler – stellte fest, dass ein KI-Modell potenziell schädliche Ratschläge bot, was Fragen zur Vertrauenswürdigkeit dieser Tools zur Steuerung des emotionalen Wohlbefindens aufwarf.

Die Tools im Spiel verstehen

Bevor wir uns mit den Einzelheiten der Erkenntnisse des Schülers befassen, ist es hilfreich, einige der beteiligten Schlüsseltechnologien zu verstehen.

- Künstliche Intelligenz (KI): KI bezieht sich auf Systeme, die intelligentes Verhalten zeigen, oft durch komplexe Algorithmen. Diese Algorithmen ermöglichen es Maschinen, aus Daten zu lernen und Entscheidungen zu treffen.

- Große Sprachmodelle: Eine bestimmte Art von KI, große Sprachmodelle, konzentriert sich auf das Verstehen und Generieren menschlicher Sprache. Sie wurden anhand umfangreicher Text- und Sprachdatensätze geschult, die es ihnen ermöglichen, Wörter und Phrasen vorherzusagen und auf Aufforderungen auf bemerkenswert menschenähnliche Weise zu reagieren. Betrachten Sie sie als unglaublich ausgefeilte Vorhersagemaschinen für Sprache.

- Entscheidungsbäume und Random-Forest-Modelle: Dies sind Lernalgorithmen, die zur Klassifizierung von Informationen oder zur Erstellung von Vorhersagen verwendet werden. Ein Entscheidungsbaum stellt eine Reihe von Fragen und schränkt die Möglichkeiten mit jeder Antwort ein, während ein Zufallswaldmodell mehrere Entscheidungsbäume kombiniert, um ein robusteres Ergebnis zu erzielen.

- Parameter: Dies sind die messbaren Bedingungen oder Variablen innerhalb eines Systems, die angepasst oder untersucht werden können. Durch die Optimierung dieser Parameter kann die Leistung des Modells optimiert werden.

Das Studentenexperiment und seine Implikationen

Der Student untersuchte, wie KI zur Unterstützung der psychischen Gesundheit eingesetzt werden könnte, mit dem Ziel, ein zuverlässiges System zu entwickeln. Sie konzentrierten sich auf einen Chatbot, der Stress bekämpfen und Bewältigungsstrategien anbieten soll. Der Student erkannte zwar das Potenzial von KI an, zeigte jedoch bei seinen Tests ein besorgniserregendes Problem auf: Der Chatbot gab manchmal Ratschläge, die unangemessen oder sogar potenziell schädlich waren.

Dieses Ergebnis unterstreicht die Grenzen aktueller KI-Modelle beim Umgang mit den Nuancen menschlicher Emotionen und der psychischen Gesundheit. Das KI-Modell berücksichtigte nicht die Komplexität einzelner Umstände oder potenzieller Auslöser, sondern bot stattdessen allgemeine Antworten, die kontraproduktiv sein könnten.

Warum das wichtig ist

Die Ergebnisse sind besonders relevant angesichts der zunehmenden Zugänglichkeit von KI-gestützten Apps und Chatbots für die psychische Gesundheit. Obwohl diese Tools eine bequeme und erschwingliche Unterstützung bieten können, sollten sie nicht als Ersatz für die professionelle Beratung durch einen Psychologen oder einen anderen Experten für psychische Gesundheit betrachtet werden. Hier ist der Grund:

- Mangelndes Kontextverständnis: KI-Modelle basieren auf Mustern in Daten. Es fällt ihnen schwer, den gesamten Kontext der Situation einer Person zu erfassen, was zu Ratschlägen führt, die möglicherweise nicht geeignet sind. Die Auswirkungen von psychischem Stress können sowohl positiv als auch negativ sein.

- Potenzial für Verzerrungen: KI-Modelle werden anhand von Daten trainiert, und wenn diese Daten Verzerrungen widerspiegeln (in Bezug auf Geschlecht, sozioökonomischen Status, Rasse oder andere Faktoren), kann die KI diese Verzerrungen in ihren Antworten aufrechterhalten.

- Risiko schädlicher Ratschläge: Wie die Erfahrung des Schülers gezeigt hat, kann KI Ratschläge geben, die ungenau, unsensibel oder sogar schädlich sind. Ein Symptom kann ein Zeichen für viele verschiedene Verletzungen oder Krankheiten sein.

Blick nach vorne

Die Arbeit des Studenten dient als warnendes Beispiel für die Notwendigkeit einer sorgfältigen Bewertung und Regulierung der KI im Bereich der psychischen Gesundheit. Bevor Sie sich bei der emotionalen Unterstützung auf KI verlassen, ist es wichtig zu bedenken, dass sich diese Tools noch in der Entwicklung befinden und erhebliche Einschränkungen aufweisen.

Ziel sollte es nicht sein, die menschliche Interaktion durch KI zu ersetzen, sondern KI als unterstützendes Werkzeug unter Anleitung qualifizierter Fachkräfte verantwortungsvoll einzusetzen.

Letztendlich bleiben menschliches Einfühlungsvermögen, klinisches Urteilsvermögen und ein tiefes Verständnis der Komplexität der psychischen Gesundheit für die Bereitstellung wirksamer Unterstützung unerlässlich. KI hat das Potenzial, in diesem Bereich ein wertvolles Werkzeug zu sein, muss jedoch mit Vorsicht und einem klaren Verständnis ihrer Grenzen angegangen werden.