L’intelligenza artificiale sta rapidamente rimodellando la società, ma il suo sviluppo rimane prevalentemente dominato dagli uomini. Questa non è solo una questione di rappresentanza; è una questione sistemica che rischia di incorporare i pregiudizi esistenti nelle stesse tecnologie che determineranno il modo in cui lavoriamo, impariamo e persino riceviamo assistenza sanitaria. Il problema non riguarda solo i set di dati difettosi: riguarda in primo luogo chi costruisce i sistemi.

Il divario di genere nello sviluppo dell’intelligenza artificiale

Attualmente solo il 25% degli studenti di informatica nel Regno Unito sono donne e la situazione sta peggiorando nella Silicon Valley. Questo non è un fenomeno nuovo: la tecnologia è stata storicamente un campo incentrato sugli uomini. Tuttavia, gli eventi recenti suggeriscono una regressione, con politiche e atteggiamenti che spingono attivamente le donne ad uscire. Ad esempio, l’ex presidente degli Stati Uniti Trump ha emesso un ordine esecutivo mirato alla “woke AI”, sostenendo la rimozione delle considerazioni sulla diversità, l’equità, l’inclusione e il cambiamento climatico dagli standard dell’IA.

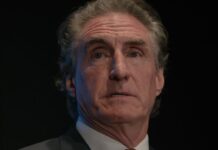

Questo ambiente ostile ha portato a mettere da parte le leader donne esperte. Rumman Chowdhury, ex responsabile dell’etica e della responsabilità di Twitter, è stato licenziato dopo l’acquisizione di Elon Musk. Nota che il sentimento anti-diversità esisteva nella Silicon Valley molto prima dell’ordine di Trump. La realtà è cruda: molti operatori del settore operano già in un mondo “senza donne”, come hanno affermato senza mezzi termini diversi esperti della conferenza sulle donne e il futuro della scienza presso la Royal Society.

Perché è importante: il divario nei dati di genere in azione

Le conseguenze di questo squilibrio vanno ben oltre l’equità. La storia è piena di tecnologie progettate per i corpi e i bisogni maschili, dai manichini per i crash test alla ricerca medica che dà priorità alla salute degli uomini. Questo è il divario nei dati di genere e i suoi effetti possono essere fatali. L’intelligenza artificiale avrà un impatto su tutto, dai mercati del lavoro all’assistenza sanitaria, ma solo il 2% dei finanziamenti in capitale di rischio va a progetti di intelligenza artificiale guidati da donne e meno dell’1% della ricerca sanitaria si concentra sulle condizioni delle donne.

Questa disparità significa che l’intelligenza artificiale rischia di perpetuare le disuguaglianze, rafforzando l’idea che la tecnologia sia utile a pochi eletti piuttosto che a tutti gli 8 miliardi di persone sul pianeta.

Il percorso da seguire: ripensare l’intelligenza artificiale da zero

Risolvere questo problema richiede qualcosa di più della semplice modifica degli algoritmi. Esperti come Rachel Coldicutt sostengono che gli attuali modelli di intelligenza artificiale sono troppo distorti per poter essere corretti e che sono necessari approcci alternativi e più inclusivi. Piuttosto che concentrarci sui rischi esistenziali, dovremmo dare priorità ai sistemi di intelligenza artificiale che si prendono cura delle persone e del pianeta.

Humane Intelligence, un’organizzazione no-profit co-fondata da Chowdhury, sta lavorando per rendere l’intelligenza artificiale più responsabile. Tuttavia, il cambiamento sistemico richiede uno spostamento degli incentivi che guidano lo sviluppo dell’IA. Come sottolinea David Leslie dell’Alan Turing Institute, dobbiamo affrontare i contesti economici e politici che scoraggiano i giovani dal perseguire l’intelligenza artificiale per il bene sociale.

In definitiva, anche la nostra definizione di intelligenza potrebbe necessitare di una rivalutazione. Le idee fondamentali dell’intelligenza artificiale derivano da un incontro degli anni ’50 al Dartmouth College, un incontro di tutti gli uomini.

Per creare un’intelligenza artificiale davvero vantaggiosa, dobbiamo riconoscere che l’innovazione prospera sulla diversità. Senza di esso, rischiamo di costruire un futuro pensato per pochi, non per i molti.