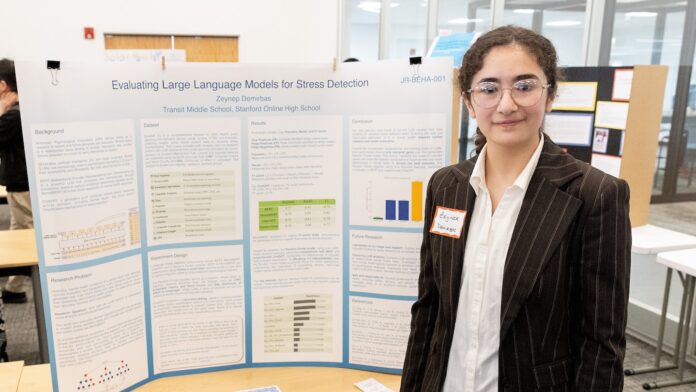

L’esperienza di uno studente di scuola media con un chatbot di intelligenza artificiale (AI) ha evidenziato le preoccupazioni sull’affidamento dell’intelligenza artificiale per il supporto della salute mentale. Lo studente, che ha partecipato alla Thermo Fisher Scientific Junior Innovators Challenge, una competizione per studenti delle scuole medie organizzata dalla Society for Science, ha scoperto che un modello di intelligenza artificiale offriva consigli potenzialmente dannosi, sollevando dubbi sull’affidabilità di questi strumenti per la gestione del benessere emotivo.

Comprendere gli strumenti in gioco

Prima di entrare nel dettaglio dei risultati ottenuti dallo studente, è utile comprendere alcune delle tecnologie chiave coinvolte.

- Intelligenza Artificiale (AI): L’intelligenza artificiale si riferisce a sistemi che mostrano un comportamento intelligente, spesso attraverso algoritmi complessi. Questi algoritmi consentono alle macchine di apprendere dai dati e prendere decisioni.

- Modelli linguistici di grandi dimensioni: Un tipo specifico di intelligenza artificiale, modelli linguistici di grandi dimensioni, incentrati sulla comprensione e sulla generazione del linguaggio umano. Sono stati addestrati su enormi set di dati di testo e parlato, consentendo loro di prevedere parole e frasi e rispondere alle richieste in un modo straordinariamente simile a quello umano. Considerateli come motori di previsione del linguaggio incredibilmente sofisticati.

- Alberi decisionali e modelli di foreste casuali: si tratta di algoritmi di apprendimento utilizzati per classificare informazioni o fare previsioni. Un albero decisionale pone una serie di domande, restringendo le possibilità per ciascuna risposta, mentre un modello di foresta casuale combina più alberi decisionali per un risultato più affidabile.

- Parametri: Queste sono le condizioni o variabili misurabili all’interno di un sistema che possono essere regolate o studiate. La regolazione di questi parametri può ottimizzare le prestazioni del modello.

L’esperimento dello studente e le sue implicazioni

Lo studente stava esplorando come utilizzare l’intelligenza artificiale per fornire supporto alla salute mentale, con l’obiettivo di sviluppare un sistema affidabile. Si sono concentrati su un chatbot progettato per affrontare lo stress e offrire strategie di coping. Pur riconoscendo il potenziale dell’intelligenza artificiale, i test condotti dagli studenti hanno rivelato un problema preoccupante: il chatbot a volte forniva consigli inappropriati o addirittura potenzialmente dannosi.

Questa scoperta sottolinea i limiti degli attuali modelli di intelligenza artificiale nel gestire le sfumature delle emozioni umane e della salute mentale. Il modello di intelligenza artificiale non ha considerato la complessità delle circostanze individuali o dei potenziali fattori scatenanti, offrendo invece risposte generiche che potrebbero essere controproducenti.

Perché è importante

I risultati sono particolarmente rilevanti data la crescente accessibilità delle app e dei chatbot per la salute mentale basati sull’intelligenza artificiale. Sebbene questi strumenti possano offrire un supporto conveniente e conveniente, non dovrebbero essere considerati sostitutivi della guida professionale di uno psicologo o di un altro esperto di salute mentale. Ecco perché:

- Mancanza di comprensione contestuale: i modelli di intelligenza artificiale funzionano in base a modelli presenti nei dati. Faticano a cogliere l’intero contesto della situazione di un individuo, portando a consigli che potrebbero non essere adatti. L’impatto dello stress psicologico può essere positivo o negativo.

- Potenziale di bias: i modelli di intelligenza artificiale sono addestrati sui dati e se tali dati riflettono pregiudizi (legati al genere, allo stato socioeconomico, alla razza o ad altri fattori), l’intelligenza artificiale può perpetuare tali pregiudizi nelle sue risposte.

- Rischio di consigli dannosi: Come ha dimostrato l’esperienza dello studente, l’intelligenza artificiale può fornire consigli imprecisi, insensibili o addirittura dannosi. Un sintomo può essere un segno di molte lesioni o malattie diverse.

Guardando al futuro

Il lavoro dello studente funge da ammonimento sulla necessità di un’attenta valutazione e regolamentazione dell’IA nella salute mentale. Prima di affidarsi all’intelligenza artificiale per il supporto emotivo, è fondamentale ricordare che questi strumenti sono ancora in fase di sviluppo e presentano limitazioni significative.

L’obiettivo non dovrebbe essere quello di sostituire l’interazione umana con l’intelligenza artificiale, ma di utilizzare l’intelligenza artificiale in modo responsabile come strumento di supporto sotto la guida di professionisti qualificati.

In definitiva, l’empatia umana, il giudizio clinico e una profonda comprensione delle complessità della salute mentale rimangono essenziali per fornire un supporto efficace. L’intelligenza artificiale ha il potenziale per essere uno strumento prezioso in questo campo, ma deve essere affrontata con cautela e comprendendone chiaramente i limiti.