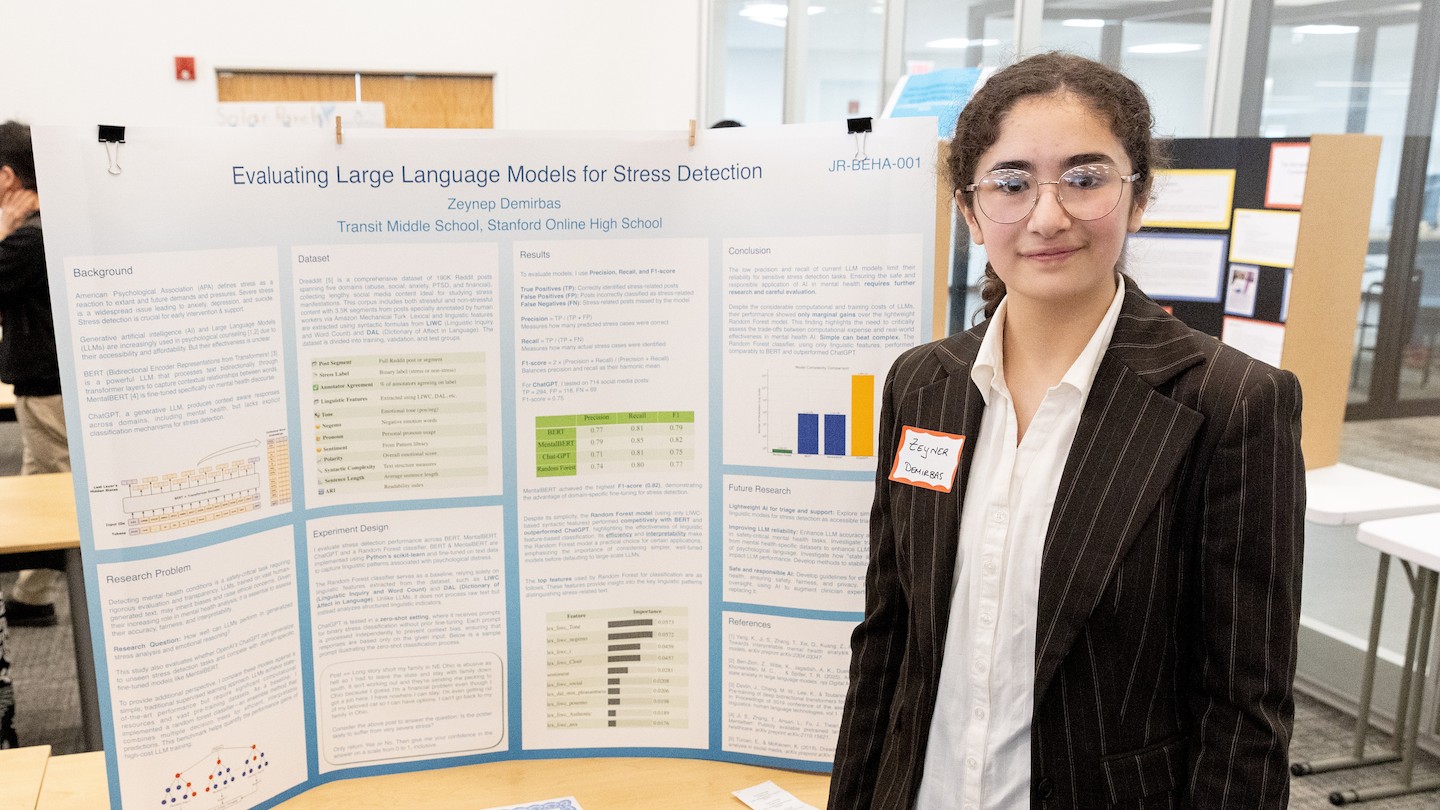

De ervaring van een middelbare scholier met een chatbot met kunstmatige intelligentie (AI) heeft de zorgen over het vertrouwen op AI voor ondersteuning in de geestelijke gezondheidszorg aan het licht gebracht. De student, die meedeed aan de Thermo Fisher Scientific Junior Innovators Challenge – een wedstrijd voor middelbare scholieren van de Society for Science – ontdekte dat een AI-model potentieel schadelijk advies bood, wat vragen opriep over de betrouwbaarheid van deze hulpmiddelen voor het beheren van emotioneel welzijn.

De tools die spelen begrijpen

Voordat we ingaan op de details van de bevindingen van de student, is het nuttig om enkele van de belangrijkste betrokken technologieën te begrijpen.

- Kunstmatige intelligentie (AI): AI verwijst naar systemen die intelligent gedrag vertonen, vaak via complexe algoritmen. Met deze algoritmen kunnen machines leren van gegevens en beslissingen nemen.

- Grote taalmodellen: Een specifiek type AI, grote taalmodellen, richt zich op het begrijpen en genereren van menselijke taal. Ze zijn getraind in enorme datasets van tekst en spraak, waardoor ze woorden en zinnen kunnen voorspellen en op een opmerkelijk menselijke manier op aanwijzingen kunnen reageren. Beschouw ze als ongelooflijk geavanceerde voorspellingsmachines voor taal.

- Beslissingsbomen en willekeurige bosmodellen: Dit zijn leeralgoritmen die worden gebruikt om informatie te classificeren of voorspellingen te doen. Een beslisboom stelt een reeks vragen, waarbij de mogelijkheden bij elk antwoord worden beperkt, terwijl een willekeurig bosmodel meerdere beslisbomen combineert voor een robuuster resultaat.

- Parameters: Dit zijn de meetbare omstandigheden of variabelen binnen een systeem die kunnen worden aangepast of bestudeerd. Door deze parameters af te stemmen, kunnen de prestaties van het model worden geoptimaliseerd.

Het studentenexperiment en de implicaties ervan

De student onderzocht hoe AI kan worden gebruikt om geestelijke gezondheidszorg te ondersteunen, met als doel een betrouwbaar systeem te ontwikkelen. Ze concentreerden zich op een chatbot die was ontworpen om stress aan te pakken en coping-strategieën te bieden. Hoewel ze het potentieel van AI erkenden, brachten de tests van de student een zorgwekkend probleem aan het licht: de chatbot gaf soms advies dat ongepast of zelfs potentieel schadelijk was.

Deze bevinding onderstreept de beperkingen van de huidige AI-modellen bij het omgaan met de nuances van menselijke emoties en geestelijke gezondheid. Het AI-model hield geen rekening met de complexiteit van individuele omstandigheden of potentiële triggers, maar bood in plaats daarvan generieke antwoorden die contraproductief zouden kunnen zijn.

Waarom dit belangrijk is

De bevindingen zijn vooral relevant gezien de toenemende toegankelijkheid van AI-aangedreven apps en chatbots voor de geestelijke gezondheidszorg. Hoewel deze hulpmiddelen handige en betaalbare ondersteuning kunnen bieden, mogen ze niet worden beschouwd als vervanging voor professionele begeleiding van een psycholoog of andere deskundige op het gebied van de geestelijke gezondheidszorg. Dit is waarom:

- Gebrek aan contextueel begrip: AI-modellen werken op basis van patronen in gegevens. Ze hebben moeite om de volledige context van de situatie van een individu te begrijpen, wat leidt tot advies dat mogelijk niet geschikt is. De impact van psychologische stress kan zowel positief als negatief zijn.

- Potentieel voor vooringenomenheid: AI-modellen zijn getraind op basis van gegevens, en als die gegevens vooroordelen weerspiegelen (gerelateerd aan geslacht, sociaal-economische status, ras of andere factoren), kan de AI deze vooroordelen in haar reacties bestendigen.

- Risico op schadelijk advies: Zoals uit de ervaring van de leerling blijkt, kan AI advies geven dat onnauwkeurig, ongevoelig of zelfs schadelijk is. Een symptoom kan een teken zijn van een van de vele verschillende verwondingen of ziekten.

Vooruitkijken

Het werk van de student dient als een waarschuwend verhaal over de noodzaak van een zorgvuldige evaluatie en regulering van AI in de geestelijke gezondheidszorg. Voordat je voor emotionele steun op AI vertrouwt, is het van cruciaal belang om te onthouden dat deze tools nog in ontwikkeling zijn en aanzienlijke beperkingen hebben.

Het doel moet niet zijn om menselijke interactie te vervangen door AI, maar om AI op een verantwoorde manier in te zetten als ondersteunend instrument onder begeleiding van gekwalificeerde professionals.

Uiteindelijk blijven menselijke empathie, klinisch oordeel en een diep begrip van de complexiteit van de geestelijke gezondheidszorg essentieel voor het bieden van effectieve ondersteuning. AI heeft het potentieel om een waardevol instrument op dit gebied te zijn, maar moet met de nodige voorzichtigheid worden benaderd en met een duidelijk begrip van de beperkingen ervan.